Viniendo del primer capítulo en este cursillo de fotografía digital, recordemos que las cámaras digitales tienen en su interior una matriz de receptores de rayos de luz. Estos receptores registran la intensidad de los rayos de luz que les impactan, provenientes del lente de la cámara.

Viniendo del primer capítulo en este cursillo de fotografía digital, recordemos que las cámaras digitales tienen en su interior una matriz de receptores de rayos de luz. Estos receptores registran la intensidad de los rayos de luz que les impactan, provenientes del lente de la cámara.

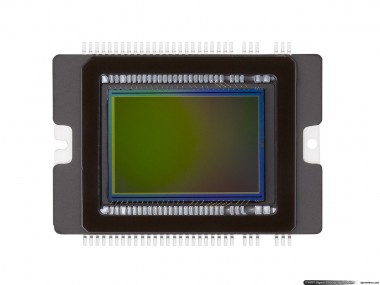

Esta matriz es muy pequeña (por ej: de 1cm x 1 cm) y consta de miles y millones de receptores independientes. A la matríz le llamaremos «sensor de imagen«. Veremos con detalle esto y los distintos tipos de sensores de imagen que se utilizan hoy en día, a continuación.

Cada receptor de imagen que captura y registra la luz se convertirá más tarde en un punto de nuestra fotografía. A cada punto se le denomina PIXEL.

Sensor de imagen

Dependiendo de la cantidad de receptores independientes que tenga el sensor de imagen, será, la calidad y detalles con la que va a capturar la imagen cuando fotografiamos.

Esto es fácil de visualizar con el siguiente ejemplo: Imagínate que queremos sacar fotos de una pelota y tenemos un sensor compuesto por una matriz de receptores de luz de 6 x 6 celdas.

La pelota se encuentra alejada, de tal forma que solamente 4 celdas «ven» los rayos de luz que rebotan de la pelota. La “imagen capturada” (o sea lo que distingue el sensor de imagen) es un cuadrado.

Si acercamos nuestro sensor de imagen de 6×6 celdas a la pelota, la luz reflejada en ella se registrará en una mayor cantidad de celdas y la forma (definición) de la pelota se aproximará a una forma redonda.

Como conclusión podemos decir que cuanto mas cerca está el objeto que queremos fotografiar de nuestra cámara y/o cuanto mas capacidad de registro tenga el sensor de imagen, mas detalle puede capturar.

Sin embargo la capacidad de diseñar sensores de imagen con gran densidad de píxeles en poco espacio no ha podido resolver un problema -sumamente técnico- de interferencia eléctrica entre ellos mismos.

Este ruido electrónico redunda en falsas lecturas, lo que a su vez degrada (a veces notoriamente) la calidad de la fotografía. Por contrapartida, si el sensor fuera más grande, se necesitaría delante de él un lente más grande también para cubrir toda su área, mayor consumo de energía, y por cierto es más caro de producir.

Del blanco y negro al color

El sensor de imagen captura solamente la luminosidad de cada pixel, por lo que estrictamente hablando, la imagen que captura es en blanco y negro (esto puede ser una sorprendente revelación, pero es cierto).

Tomando en cuenta que a partir de los 3 colores básicos (verde, azul y rojo) se puede formar cualquier color, entonces las cámaras digitales se aprovechan de esto y ponen por encima de su sensor de imagen un filtro de color básico puesto encima.

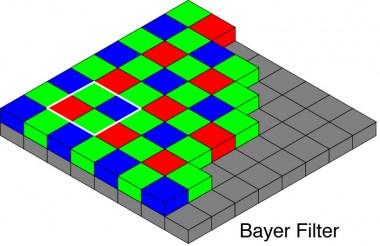

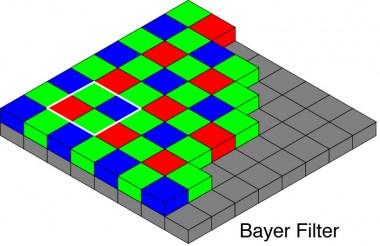

Filtro Bayer de colores

Este filtro fue inventado por Bryce Bayer y se le denomina Filtro Bayer. Funciona así:

Este filtro fue inventado por Bryce Bayer y se le denomina Filtro Bayer. Funciona así:

El sensor de imagen que ve en blanco y negro se representa con la superficie gris.

El filtro Bayer, situado por encima, deja pasar a los rayos de luz en forma intercalada a cada pixel del sensor el rojo, azul y verde (el doble de verde, dado que el ojo es particularmente sensible al verde).

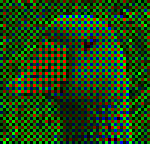

De esta forma se termina con una representación de la imagen original, siempre en degradé de blanco y negro, pero filtrada por los tres colores primarios, en ese patrón de tablero de ajedrez multicolor.

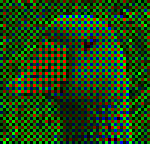

La cámara, con una serie de algoritmos complejos, procesa estas tres vistas monocromáticas, sabiendo que píxel representa cada color primario, y sumando así los tres colores primarios por cada grupo de 4 pixeles y recomponiendo de esa sumatoria la información cromática original.

Nota por favor que si bien la imagen original, en cuanto a la luminancia (en blanco y negro) fue capturada por todos los pixeles del sensor de imagen de tu cámara digital, luego al computar el color real para pintar esos píxeles, la historia es bien distinta.

Nota por favor que si bien la imagen original, en cuanto a la luminancia (en blanco y negro) fue capturada por todos los pixeles del sensor de imagen de tu cámara digital, luego al computar el color real para pintar esos píxeles, la historia es bien distinta.

Reiteramos: La computadora interna de tu cámara de fotos tuvo que procesar los degradés en verde, azul y rojo de 4 píxeles (recuerda que el verde utiliza dos pixeles, por cada pixel de rojo y azul) para generar el color «general» de esa área de 4 píxeles.

Dicho de otra forma, gran parte de los colores que muestra tu cámara digital, fue extrapolado de la -relativamente- escasa información cromática disponible: La información real cromática es solamente 1/4 de la información del total de los píxeles de la cámara.

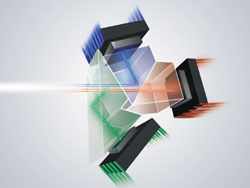

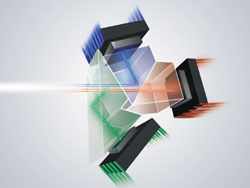

Alternativa 1: Tres sensores de imagen

Como alternativa de calidad superior al mecanismo de los filtros BAYER que vimos aquí arriba, las mejores cámaras de video (nunca vi en fotografía, pero es bastante común en video, en las cámaras profesionales, y algo básico para las cámaras para televisión) usan 3 sensores de imagen al mismo tiempo. Cada sensor de imagen registrará la imagen completa, filtrada por un color primario distinto.

Como alternativa de calidad superior al mecanismo de los filtros BAYER que vimos aquí arriba, las mejores cámaras de video (nunca vi en fotografía, pero es bastante común en video, en las cámaras profesionales, y algo básico para las cámaras para televisión) usan 3 sensores de imagen al mismo tiempo. Cada sensor de imagen registrará la imagen completa, filtrada por un color primario distinto.

Para «repartir» la imagen que entra por el lente de la cámara entre los tres sensores, se coloca un prisma de cristal cortado de tal manera que reparte los rayos de luz en tres direcciones distintas. De esta manera la imagen se captura con mejor resolución de color, al mismo tiempo en los tres colores primarios.

El problema es que al dividir la luz que entra por el lente en tres caminos distintos, efectivamente a cada camino llega 1/3 de la luz, lo que genera problemas al usar estas cámaras en condiciones de luz inferior. En la práctica, la diferencia de calidad de una cámara de 3 sensores es notoriamente superior, contra una de un solo sensor. Pero lamentablemente en fotografía, esa disminución de sensibilidad a la luz, no tiene andamiento.

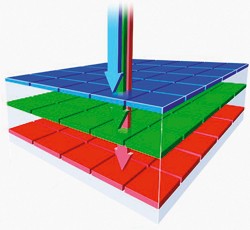

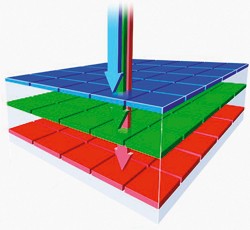

Alternativa 2: Sensor de imagen FOVEON

Esta es una alternativa elegante, y es un nuevo tipo de sensor, que se diseño en la época de los 90, en USA, denominado FOVEON. Replica con más exactitud el comportamiento del ojo humano, y en un mismo sensor de imagen, tiene la habilidad de ver los tres colores primarios en cada pixel.

Esta es una alternativa elegante, y es un nuevo tipo de sensor, que se diseño en la época de los 90, en USA, denominado FOVEON. Replica con más exactitud el comportamiento del ojo humano, y en un mismo sensor de imagen, tiene la habilidad de ver los tres colores primarios en cada pixel.

Simplificando su funcionamiento, es como si fueran tres sensores separados, pero están montados uno arriba del otro. Cada sensor recoge los rayos de luz cuya frecuencia coincide con su color primario y deja permear el resto de la luz hacia el sensor que le sigue más abajo.

De esta manera, todos los rayos de luz son procesados, en un mismo sensor y esto trae aparejado una infinidad de ventajas. Por ejemplo hay 0 desalineamiento entre cada color y es mucho mas robusto a golpes. La calidad es INCREIBLEMENTE MEJOR, y hasta podríamos decir que el resultado es la versión sintética de cómo se comportaban las películas de rollo para cámaras analógicas.

![]() Razonando desde el capítulo anterior de este cursillo de fotografía digital:

Razonando desde el capítulo anterior de este cursillo de fotografía digital: Si el tamaño del sensor de imagen permite acomodar todos esos megapixeles, manteniendo una relación favorable de calidad con respecto al ruido electrónico, sin dudas que es favorable.

Si el tamaño del sensor de imagen permite acomodar todos esos megapixeles, manteniendo una relación favorable de calidad con respecto al ruido electrónico, sin dudas que es favorable.![]() Para imprimir una foto a 10cm x 15cm (típica foto de álbum) una cámara de 3.1 megapixeles ya se basta -lo digo por experiencia- para que a simple vista, analizando la impresión, no podamos distinguir puntos, y la fotografía quede perfecta. Logicamente, hablamos de un servicio de impresión fotográfico (no una impresora doméstica).

Para imprimir una foto a 10cm x 15cm (típica foto de álbum) una cámara de 3.1 megapixeles ya se basta -lo digo por experiencia- para que a simple vista, analizando la impresión, no podamos distinguir puntos, y la fotografía quede perfecta. Logicamente, hablamos de un servicio de impresión fotográfico (no una impresora doméstica).